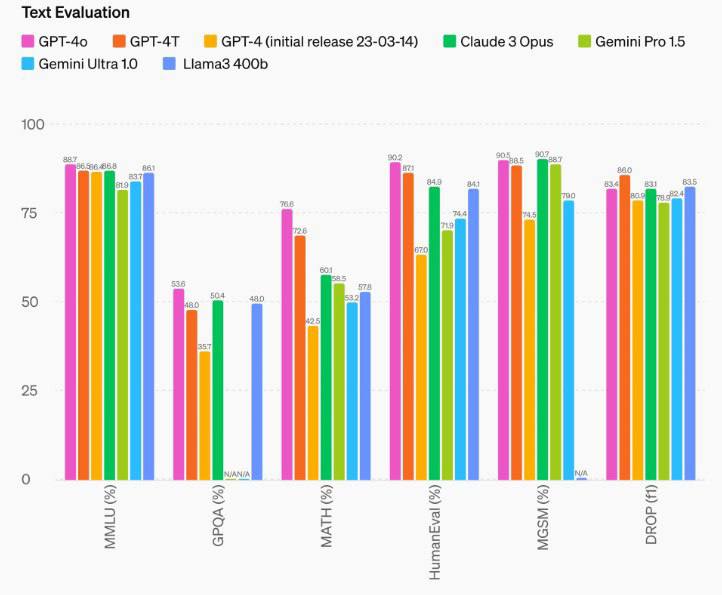

OpenAI представила ИИ-модель GPT-4o

Буква «о» в названии GPT-4o означает omni (всесторонний), что указывает на мультимодальность модели. Она, как следует из сообщения компании, имеет интеллект «уровня GPT-4», но значительно расширяет ее возможности и может анализировать звук, изображение и текст в режиме реального времени. GPT-4o получила контекстное окно в 128 тыс. токенов.

Буква «о» в названии GPT-4o означает omni (всесторонний), что указывает на мультимодальность модели. Она, как следует из сообщения компании, имеет интеллект «уровня GPT-4», но значительно расширяет ее возможности и может анализировать звук, изображение и текст в режиме реального времени. GPT-4o получила контекстное окно в 128 тыс. токенов.

Среди возможностей новой модели называются:

– время реакции на голос в среднем составляет 320 мс, что сравнимо с реакцией человека в разговоре;

– определение эмоций и изменение интонации при общении;

– доступ более чем на 50 языках, в том числе на русском;

– синтез объектов в 3D;

– лучшее восприятие и анализ изображений, включая графики, диаграммы и скриншоты, по сравнению с существующими моделями.

В OpenAI считают, что модель значительно улучшит работу чат-бота ChatGPT. В частности, функции обработки текста и изображений должны появиться в ChatGPT в ближайшее время.